VideoGigaGAN ma rozwiązać problemy innych upscalerów video GAN

Głównym problemem, z jakim borykają się twórcy silników GAN (Generative Adversarial Network), są pojawiające się artefakty i migotanie przeskalowanego obrazu. Z kolei istniejące metody VSR służące do podnoszenia rozdzielczości obrazów filmowych pozbawione są podobnych problemów, ale ich działanie daje obraz mniej ostry i z mniejszą ilością szczegółów.

Przedstawiony przez wynalazców z Adobe 18 kwietnia 2024 roku nowy silnik VideoGigaGAN celuje w połączenie cech obu rozwiązań i ma na celu osiągnięcie jakości i szczegółowości obrazu charakterystycznego dla GAN, wprowadzając jednocześnie rozwiązania mające na celu zachowanie odpowiedniej spójności czasowej kolejnych klatek i w efekcie zmniejszenie lub likwidację powstających w wyniku działania standardowego GAN artefaktów.

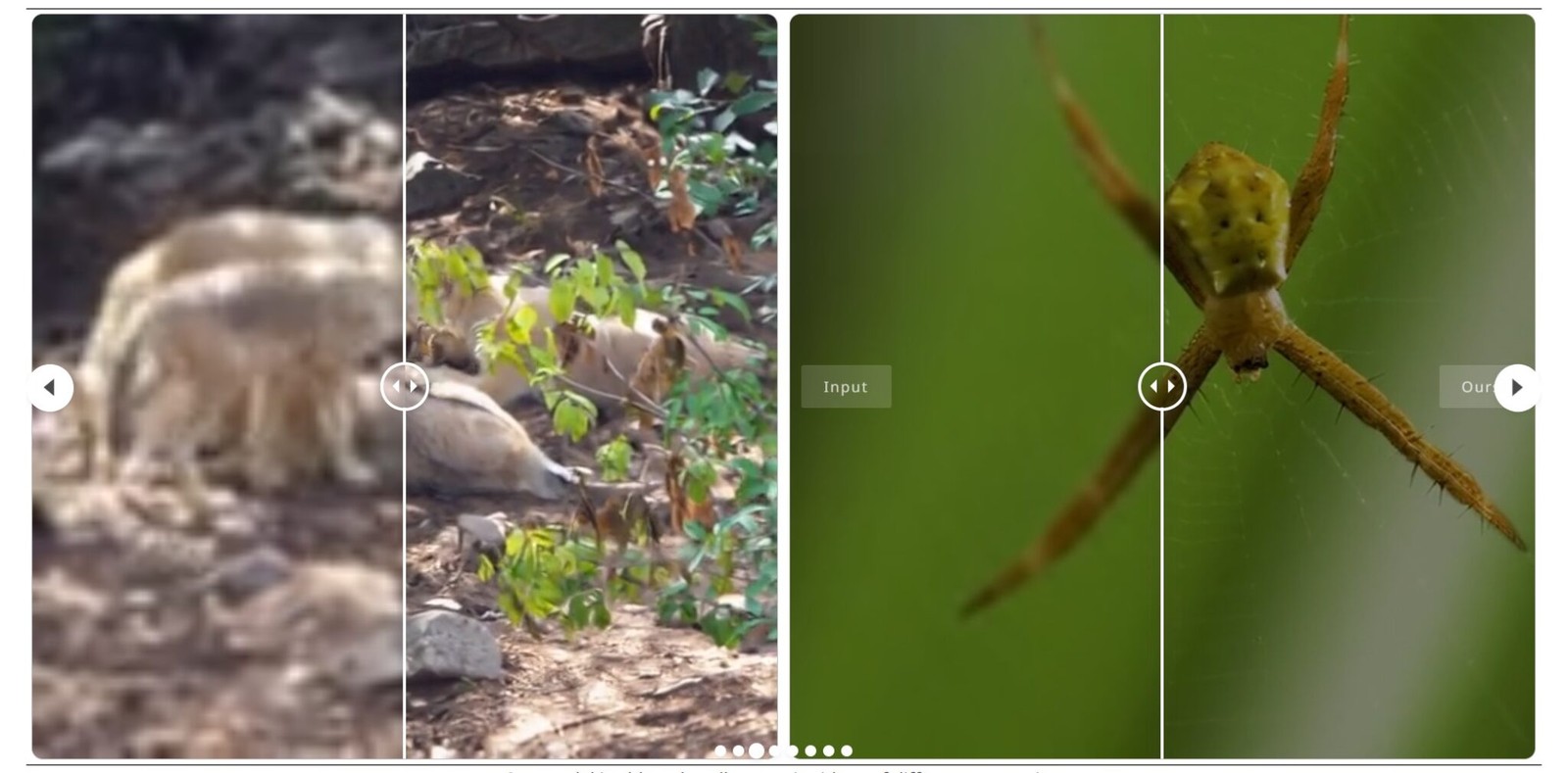

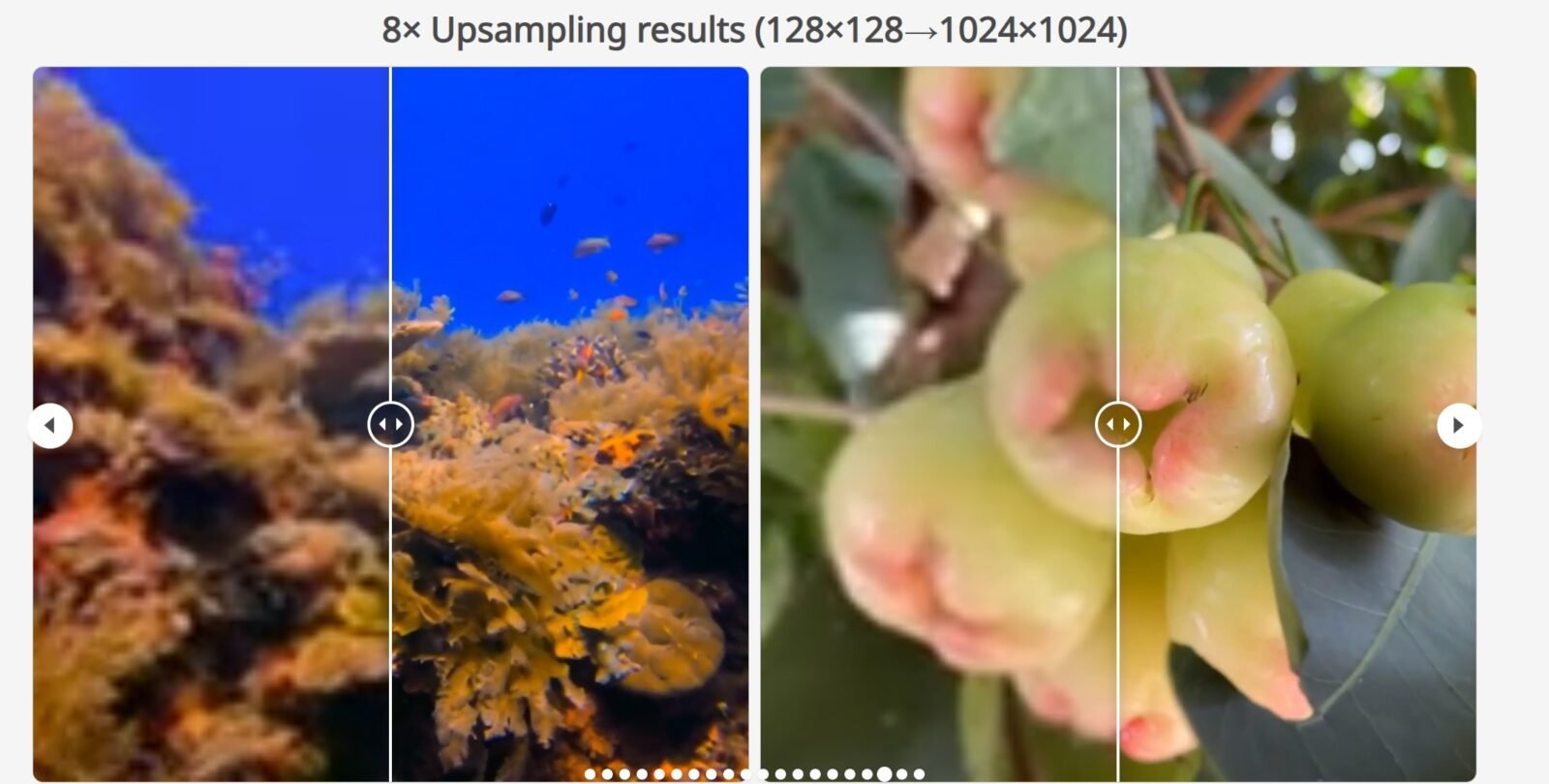

Dostarczone przez Adobe przykłady wyglądają bardzo obiecująco. Na nagraniach twarzy z pomocą AI odtworzone zostały detale skóry i brwi, w zasadzie całkowicie nieobecne na oryginalnym nagraniu, a mimo to wyglądają naturalnie i odpowiednio także się zachowują – trudno poznać, co na obrazie w jakiejś formie istniało wcześniej, a co zostało całkowicie wyobrażone przez AI i dodane do obrazu.

Tak samo skutecznie VideoGigaGAN poradził sobie z kocim futrem i trawą, gorzej wypadając jedynie w scenie z wodospadem, który wprawdzie wygląda naturalnie, ale jego rozdzielczość i szczegółowość wydają się niższe, niż bardziej statycznych elementów sceny. Na stronie projektu jest także możliwość porównania działania VideoGigaGAN z innymi istniejącymi technikami VSR. Przykłady dostępne są także na Threads:

Opublikowane przez: @luokaiWyświetl w Threads

Zamieszczone powyżej przykłady działania VideoGigaGAN są efektem pracy bardzo wstępnej wersji silnika. Efekty jednak już teraz wydają się na tyle dobre, żeby konkurencja poczuła na plecach oddech Adobe, choć trzeba przyznać, że potentat ma sporo do nadrobienia – Topaz AI może i radzi sobie gorzej, ale od dawna jest dostępny komercyjnie, a producent program wciąż rozwija. Podobne prace prowadzi Microsoft i Nvidia – dość prosty silnik skalowania obecny jest przecież od dawna w sterownikach dla GPU Nvidii, ale potraktowanie nim filmy wyglądają dość sztucznie. Pozostaje mieć nadzieję, że Adobe nie poprzestanie na przykładach i w niedalekiej przyszłości VideoGigaGAN trafi do Creative Cloud.

Zobacz także: Kwietniowy sterownik Nvidia Studio to przyśpieszenie w Adobe Premiere Pro i DaVinci Resolve (chip.pl)